もう使えないと思っていた古いパソコンが、最新のAI専用機に出来るんです

しかも月額ゼロ円で、インターネットに接続しないローカルAIです

ローカルAIとは、パソコン上で動くAIのことで、データが外部に漏れずセキュリティが高いこと

ということで今回の記事テーマは・・・

というお話しです

クラウドAIとローカルAIとの違い

ChatGPTやGeminiなど、多くの人が使っているのはネット経由で外部サーバーに接続するAIです

クラウドAIは高性能ですが、ネット接続必須で月額課金が発生することもあります

一方でローカルAIは、自分のパソコンの中だけで動くAIなので、処理はすべてパソコン内部で完結します

| 比較項目 | クラウドAI | ローカルAI |

|---|---|---|

| 動作場所 | インターネット上のサーバー | 自分のパソコン内 |

| ネット接続 | 必須 | 不要でも使える(オフライン可) |

| 月額費用 | 有料プランあり | 基本ゼロ円 |

| 処理性能 | 非常に高い | PC性能に依存 |

| データの扱い | 外部サーバーへ送信 | PC内で完結 |

| 導入難易度 | すぐ使える | 初期設定が必要 |

だからローカルAIは、ネット接続不要で月額ゼロで運用が可能なのです!

\簡単に作れる!AIで写真をフィギュア加工/

ローカルAIメリット

そんなオフラインで使える、ローカルAIの最大魅力は、なんといっても “月額ゼロで使える”ことだと思います

有料の高機能クラウドAIと違って、ローカルAIは基本的に無料!

しかもパソコン内部で完結するということは、個人情報などが外部に漏れることは基本的にありません!

さらにAIモデルもパソコンスペックに合わせて選択できるから、古いパソコンの再利用にピッタリです

- 月額ゼロで使える

- データ漏洩が基本ない

- 古いパソコンでも活用できる

ローカルAIデメリット

もちろんローカルAIにもデメリットがあって、最大のデメリットは“パソコンスペックに依存する”ことです

クラウドAIの場合、データセンターで処理されますが、ローカルAIは手元のパソコンが全て!

古いCPUや少ないメモリ、GPU非搭載の場合、処理が遅くなるので、クラウドAIのような高性能は期待できません

さらにブラウザですぐ使えるクラウドAIと違って、多少の初期設定などが必要になります

- AIの性能はパソコンに依存

- 最新クラウドAIほど高性能ではない

- 初期設定が少し面倒

Ollamaの使い方|導入は意外と簡単

ローカルAIの仕組みや、メリット・デメリットは判っていただけましたか?

でも、どうやってローカルAIをパソコンにいれるの?

ということで今回 “Ollama(オラマ)”というローカルAI実行ツールと、gemma / llamaというAIモデルを使って説明します

AI実行ツールは、AIを動かすための“体”みたいなもので、AIモデルは、その中に入ってる“頭脳”みたいなものです。

他にもローカルAI実行ツールはあるんですが、Ollamaは“導入やAIモデルの管理が簡単”つまり初心者向けなのです

インストール手順:Windows

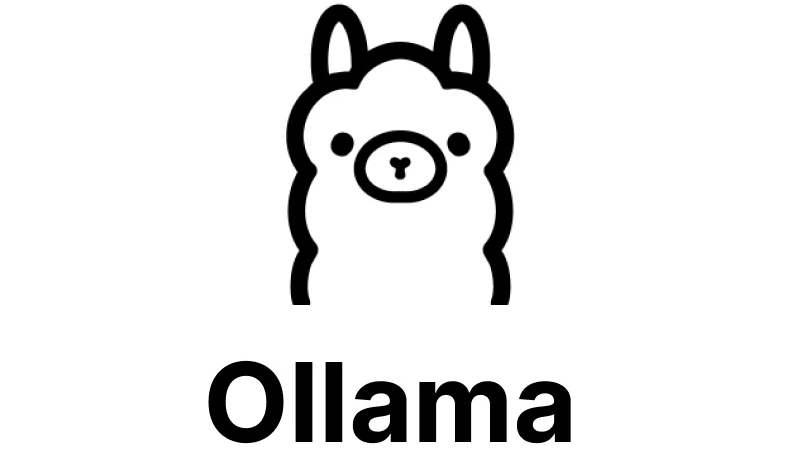

まずはローカルAI実行ツール“Ollama”の公式サイトを表示します

公式サイト右上 “Download” をクリックします

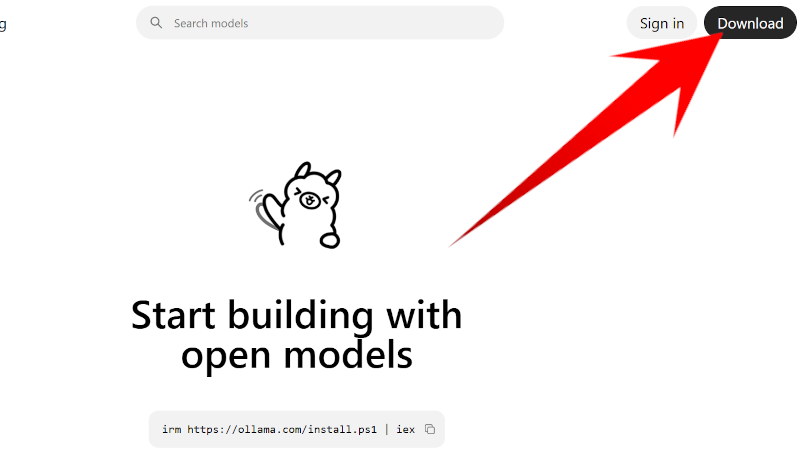

次に“Download for Windows”をクリックします

ダウンロードしたファイルを実行すれば、インストールが開始されます

ターミナル(Mac)やPowerShell(Windows)でも、コマンド入力でインストールが可能です。Linuxはコマンドインストールのみとなります。

モデルの入れ方:gemma(llama)

Ollamaをインストールすると、クラウドAIのような画面が起動します

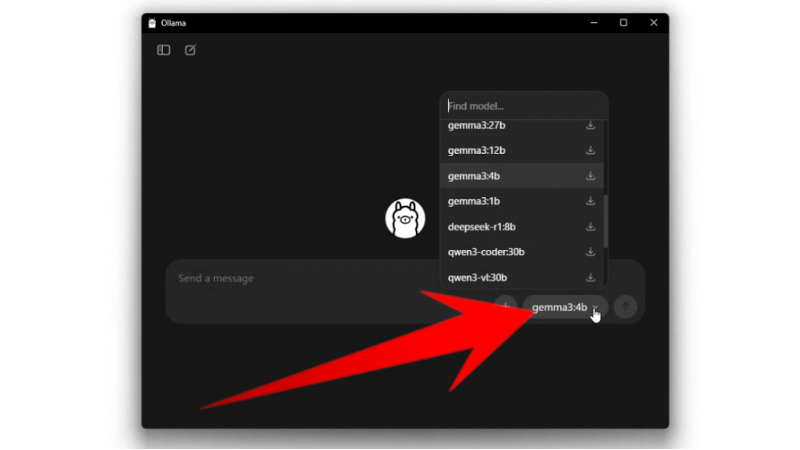

次にチャット入力画面の下にある、AIモデル メニューを表示します

今回“gemma3:4b” をインストールするので、モデルを選択してプロンプトを入力するとモデルのダウンロードが開始されます

※AIモデルの特徴は、次の“必要スペックの目安”を参照してください

インストールが完了すると、ChatGPTやGoogle Geminiのように、プロンプトに対して回答してくれます

もちろんオフラインでも、回答してくれますよ!

AIモデルは、初回のみネット接続によるダウンロードが必要になります。

リストに無いAIモデルをインストールする方法

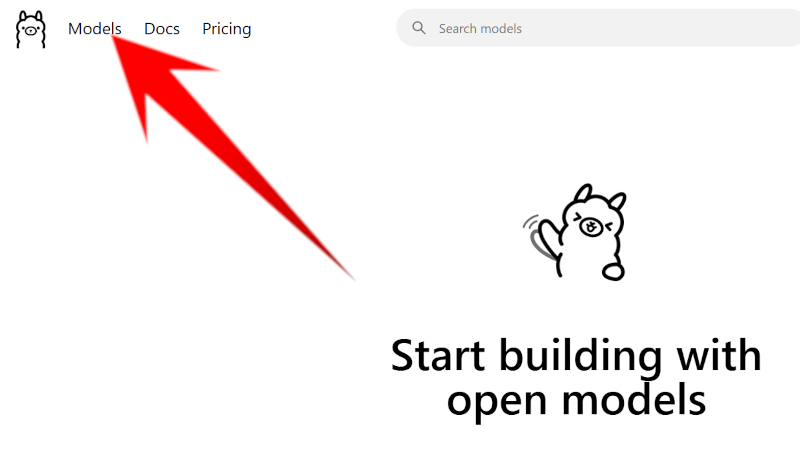

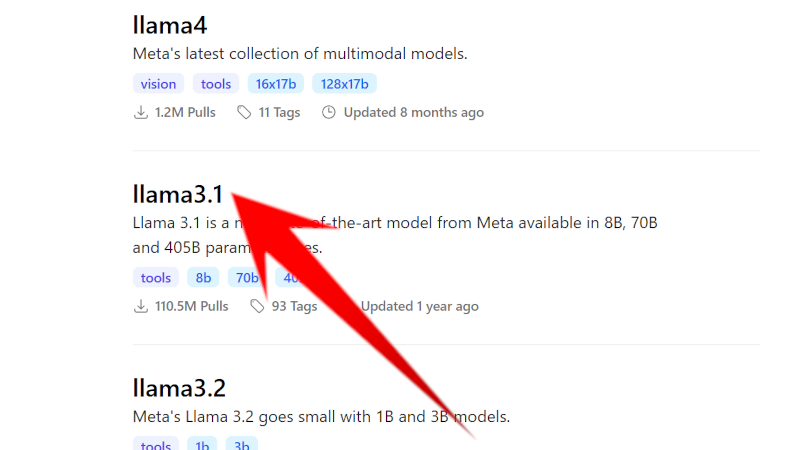

メニューに表示されていない、AIモデルをインストールする場合、Ollama公式サイト左上の“Models”をクリックします

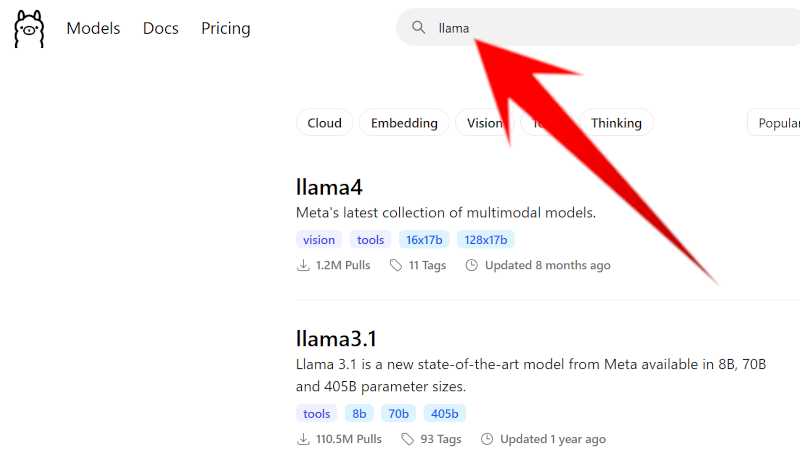

たとえばMeta社が開発した“llama”は、古いパソコンでも動くモデルで、長文などの生成にも優れています

そこで検索で“llama”を入力します

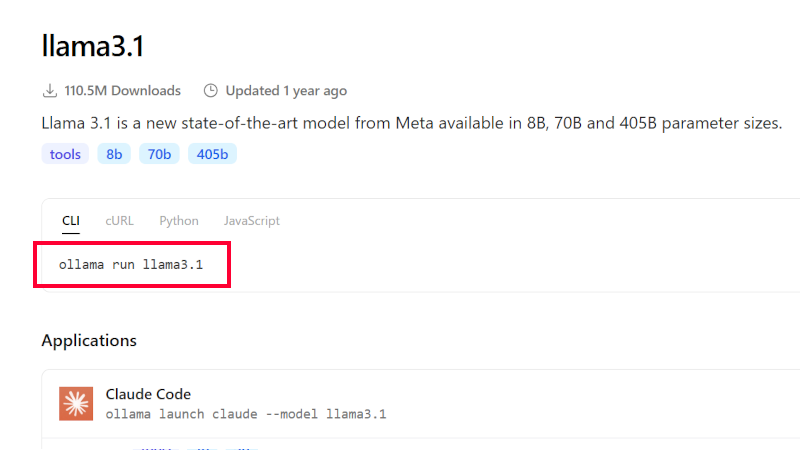

安定バージョンの“llama3.1”をクリックします

コマンド(赤枠)が表示されているので、コピーをクリックします

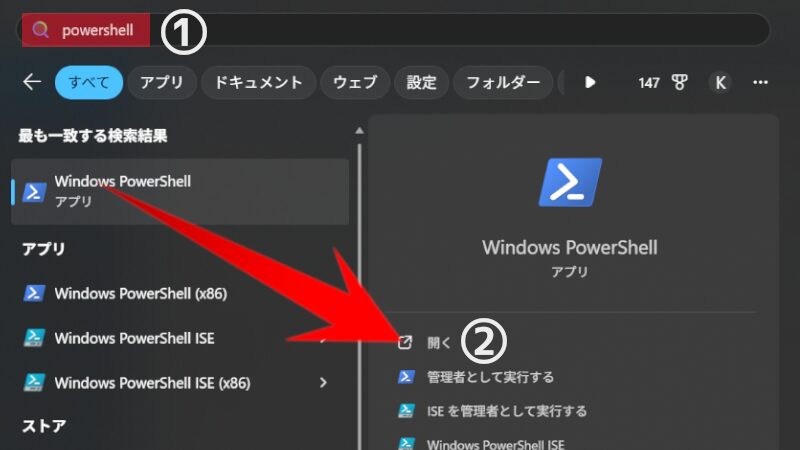

次にWindowsキーをクリックして“PowerShell”と入力して起動します

“PowerShell”が起動したら、先ほどのコマンドの末尾に、AIモデル サイズを追加(今回は:8b)して実行します

暫く時間がかかりますが “success”と表示されると完了です

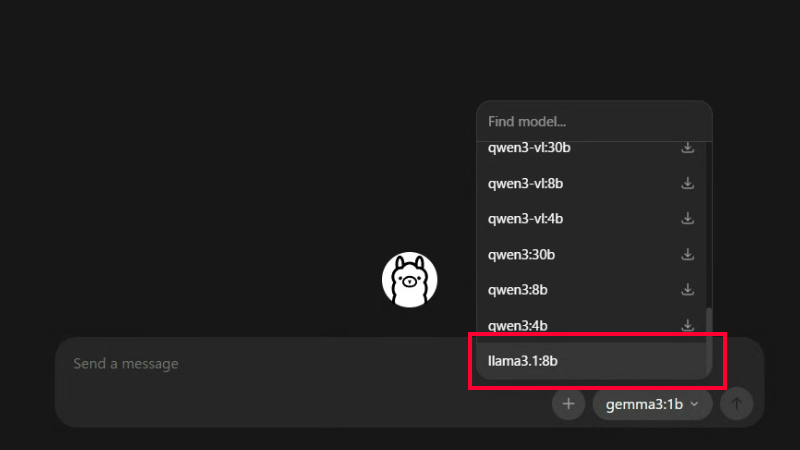

AIモデル メニューを表示すると“llama3.1”が追加されていました

必要スペックの目安

AIモデルが多くてどれを選べばいいの?

確かにモデルの数が多すぎて、どれがいいのか判りにくいですよね

まずは代表的なモデルの特徴と用途を紹介します

| モデル | 得意分野 | 軽さ | 日本語 | 古いPC | 用途 |

|---|---|---|---|---|---|

| Llama系 | バランス型 | ★★★ | ★★★ | 8Bまで可 | 一般用途 |

| Gemma系 | 軽量・安定 | ★★★★ | ★★ | 4Bなら◎ | 低スペックPC運用 |

| Mistral系 | 推論・コード | ★★★ | ★★ | 7Bなら可 | 技術系・分析用途 |

| Phi系 | 超軽量 | ★★★★★ | ★★ | ◎ | 軽く動かしたい |

| Qwen系 | 会話・日本語 | ★★★ | ★★★★ | 7Bまで可 | 日本語中心の用途 |

| CodeLlama | プログラミング | ★★★ | ★★ | 7Bまで可 | コード生成特化 |

次にAIモデルのサイズについて簡単に説明します

AIモデルのサイズb(Billion)は、AIモデルの規模の目安で、数字が大きいほど複雑な回答が出来ますが、高性能なパソコンが必要となります。

| サイズ | CPU目安 | メモリ | GPU | 体感 |

|---|---|---|---|---|

| 1~3B | 旧世代可 | 8GB | 不要 | 快適 |

| 4B | 第6世代以降 | 8GB | 不要 | 実用 |

| 7B | 第8世代以降 | 16GB推奨 | あると良い | やや重い |

| 8B | 第8世代以降 | 16GB推奨 | あれば安定 | ギリ実用 |

| 13B以上 | 高性能CPU | 32GB | ほぼ必須 | 重い |

古いパソコンにローカルAIをインストールする場合、4bまでなら比較的快適に動作すると思います

では実際に、我が家の古いゲーミングパソコンで動かしてみます

古いパソコンで実際に動かしてみた

今回ローカルAIの検証環境として利用するのが、2013年発売の ALIENWARE X51です

多少スペックアップしていますが、もはや骨董品のパソコンです

| CPU | Corei5-4440 |

| RAM | 16.0GB |

| SSD | 480GB |

| GPU | GTX660 |

果たして本当に動くのか!?そもそもプロンプトに対して、正しい答えを出すことが出来るのか検証します

\古いパソコン捨てるのはモッタイナイ!使い道を考えています/

ローカルAIを古いパソコンで動かしてみた結果

ということで比較用の以下プロンプトを用意して、ローカルAIで試してみました

「インターネットが突然使えなくなった世界では、人々の生活はどう変化するか」を300文字程度で説明してください。メリットとデメリットの両方を含め、最後に簡単な結論を1文でまとめてください。

インターネットが突然使えなくなると、まず買い物や銀行手続き、仕事のやり取りが滞り、在宅勤務やオンラインサービスは成り立たなくなります。教育も対面中心に戻り、情報収集はテレビや紙媒体が再び主役になるでしょう。一方で、家族や地域との直接的な交流が増え、デジタル依存から解放されるというメリットも考えられます。しかし経済活動の停滞や情報格差の拡大は避けられません。結論として、利点はあるものの社会全体への影響は極めて大きいと言えます。

gemma3の回答

まずgemma3の回答は以下の通りです

インターネットが突然使えなくなった世界では、社会全体が大きく変化します。コミュニケーションは手紙や電話に移行し、情報伝達は大幅に遅延します。経済活動は、実店舗や対面取引への回帰を伴い、電子商取引は崩壊します。一方で、地域社会との繋がりが強化され、人々の交流やコミュニティ意識が高まる可能性があります。 知識の蓄積は図書館や専門家への依存度が増し、教育システムも変化します。しかし、情報格差が拡大し、孤立感や停滞感を抱く人々も現れるでしょう。

結論として、インターネットの不在は人々の生活様式を根底から変え、新たな社会構造を形成する一方で、多くの課題も生み出すことになるでしょう。

ChatGPTの内容とほぼ変わりませんが、電子商取引など表現が若干固くなっている感じがしました

質問してから回答が表示されるまでは、約40秒かかりました

llama3.1の回答

次にllama3.1の回答です

「インターネットが突然使えなくなった世界」では、人々の生活は大きく変化することになります。

まず、生活の中での便利さと快適さが失われることです。スマートホームの制御やオンラインショッピングなどのサービスが利用できなくなるため、日常生活で大きな不便を感じることになります。また、仕事では、通信ができる環境はもちろん、ビデオ会議やデータの共有など、インターネットに依存する作業にも影響が出てしまいます。

しかし、一方では、人々はもっと親密になる機会を持つことができます。実際の場所でコミュニケーションを図ることによって、人とのつながりが深まります。また、人々は再び自分自身と自分の環境に注目するようになり、都市部から郊外や自然へと移住する例も増えています。

結論としては、インターネットの存在は人生を大幅に変えました。

文書量はChatGPTやgemma3と比べても一番多く、内容に関しては“スマートホーム”などより身近で具体例が挙げられていました

文書量が多い分、回答時間は1分30秒ほどかかりました

正直ローカルAIってどう?使ってみた本音

今回のX51(i5-4440 / RAM16GB / GTX660)では、“4bはギリ実用可能、8bは待ち時間が気になる”という体感でした

8b以上のAIモデルを使いたい人は、高性能パソコンでの利用をお勧めします

とはいえローカルAIという点では使ってみて魅力を感じることも多く、今後の活用方法が膨らみました

ローカルAI 良かった点

まず一番大きいのは、やはり無料で回数制限が実質ないということ!一度環境を整えてしまえば基本ゼロ円で使えます

そして自由に使えるからこそ、活用方法へのワクワク感があります

- 小型パソコン入れて持ち歩ける“相談役”にする

- 災害時など非通信下での情報端末として使う

- ヌイグルミに仕込んでロボットペットにする

さらにセキュリティが厳しい社内パソコンでも、確認は必須ですが “外部通信をしないAI” としてなら利用の可能性が見えてきます

今後個人的に色々挑戦してみたい分野のAIですね

ローカルAI 微妙だった点

とはいえ今回は古いパソコンで試したのもあって、スムーズに回答されず“実用的か?”と問われると微妙でした

スペックの低いパソコンで使うなら、1〜3Bが現実的です

ちなみに先ほどと同じプロンプトをgemma3:1bで試すと・・・

「インターネットが突然使えなくなった世界」は、生活に大きな混乱をもたらす可能性があります。コミュニケーションは途絶え、情報収集・交流が困難になり、経済活動も大きく乱れます。人々の生活は、アナログ的な活動に戻り、地域社会の繋がりが強まるかもしれません。しかし、情報へのアクセスが失われ、経済活動が停滞し、社会全体が混乱する可能性もあります。

【メリット】

・アナログな生活への反動。

・地域コミュニティの再構築。

・情報伝達の遅延を避けるため。

【デメリット】

・経済活動の停滞。

・情報伝達の遅延。

・社会全体の混乱。

結論: インターネット依存度が高い社会では、社会の安定と生活の質を維持するためには、アナログな生活を重視し、地域社会との繋がりを強化する必要があるでしょう。

回答の内容は似たものですが、より簡潔な答えになっていて、10秒ほどで回答してくれました

ローカルAIは古いパソコンの使い道としてアリか?

今回10年以上前の古いパソコンに、最新のローカルAIをインストールしてみて、非常に可能性を感じました

もちろん本気で活用するには、高性能パソコンが必要ですが、実験用や趣味程度の活用方法なら古いパソコンでも十分です

制限なくAIを使ってみたい人には、ローカルAIオススメです!

AIってプロンプト次第で、優秀な答えも出せば見当違いな答えも出してきます

まずは色々会話してみることが、AIの第一歩ですね